ChatGPT: Vom Datenschutz zur KI-Regulierung

Mit der stetigen Weiterentwicklung von Künstlicher Intelligenz (KI) ist die digitale Zukunft bereits heute ansatzweise spürbar – dies verdeutlicht besonders der aktuelle Hype um ChatGPT und seine Potenziale. Mit der öffentlichen Aufmerksamkeit geht aber auch ein wachsendes Bewusstsein für die möglichen Gefahren von KI-Anwendungen einher, gerade mit Blick auf den Datenschutz und eine umfassende Regulierung.

KI-Textroboter (öffnet in neuem Tab) sind seit dem Start von ChatGPT in aller Munde und sorgen in vielen Branchen, in denen Texte eine Rolle spielen, sowohl für hohe Erwartungen als auch Besorgnis. Doch mit dem Hype um ChatGPT werden ebenso vermehrt Fragen nach den Herausforderungen und Risiken von KI-generierten Texten laut. Im Zentrum stehen dabei vor allem Aspekte wie Datenschutz, Urheberrechte oder Desinformation.

Italien als Auftakt einer längeren Prüfung?

So gab es in Italien bereits eine temporäre Sperrung (öffnet in neuem Tab) des Programms aus Jugend- und Datenschutzgründen, die Ende April wieder aufgehoben wurde. Zuvor musste OpenAI, das US-Unternehmen hinter ChatGPT, allerdings einige Nachbesserungen vornehmen: eine Altersprüfung für neue Nutzer:innen, kein Zugriff für Minderjährige sowie eine Widerspruchsregelung für das Sammeln und Speichern personenbezogener Daten. Die Software ist dort nun zwar wieder verfügbar, allerdings hat die italienische Datenschutzbehörde angekündigt, ChatGPT weiterhin zu prüfen.

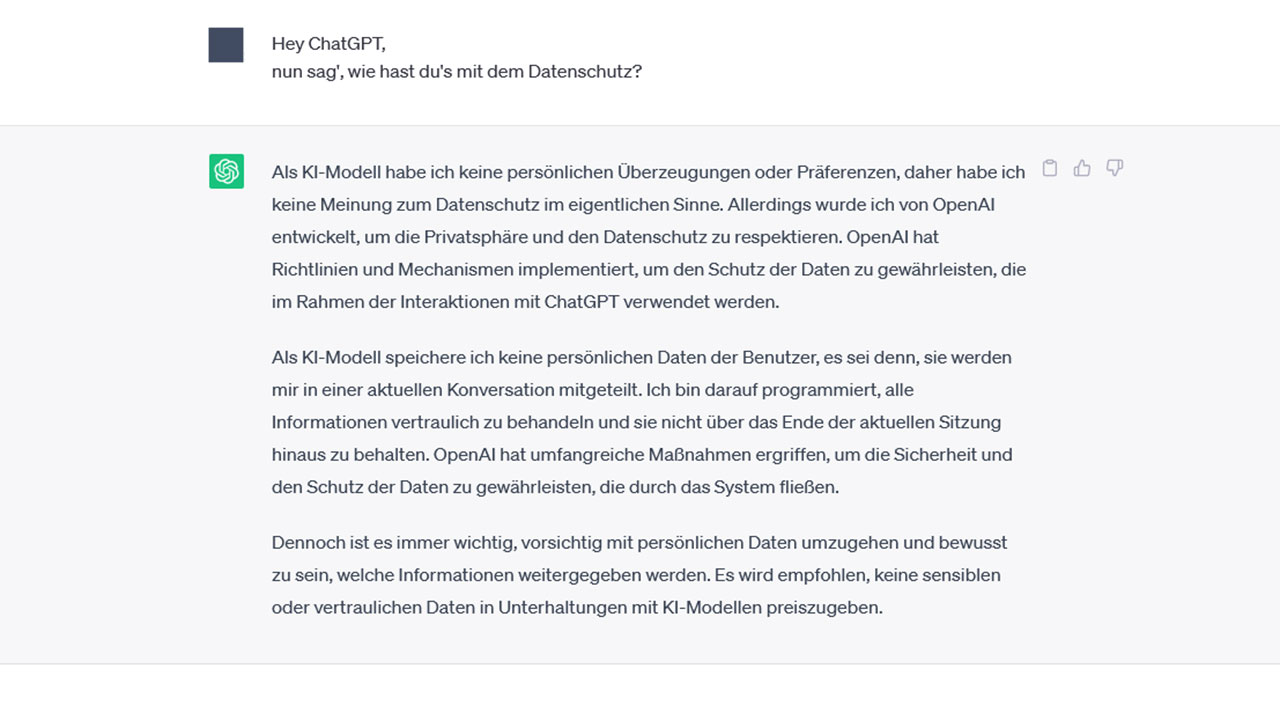

Zudem haben auch Spanien (öffnet in neuem Tab) und andere europäische Länder Untersuchungen der Datenschutz-Praxis von OpenAI angekündigt. In Deutschland wurde inzwischen ein Verwaltungsverfahren gegen Open AI eröffnet, bei dem die Behörden mehr über die Funktionsweise von ChatGPT herausfinden möchten. Im Zentrum stehen dabei insbesondere die Fragen, wie die Algorithmen des Programms trainiert werden, woher die Daten dafür stammen und ob bei der Verwendung durch die Nutzer:innen die Datenschutzgrundverordnung (DSGVO) eingehalten wird, also z.B. Betroffenenrechte zur Auskunft, Berichtigung und Löschung der eingegebenen Daten.

Ziel ist ein rechtskonformer Chatbot

Initiiert wurde das Verfahren hierzulande von der Datenschutzkonferenz (öffnet in neuem Tab) – einem Gremium, in dem sich regelmäßig die „unabhängigen Datenschutzaufsichtsbehörden des Bundes und der Länder“ treffen und koordinieren. Dessen neu gegründete KI-Taskforce hat einen Fragenkatalog für OpenAI vorbereitet, den das Unternehmen laut FAZ (öffnet in neuem Tab) bis zum 7. Juni beantworten soll. Je nachdem, wie die Antworten ausfallen, wird die KI-Taskforce weitere Maßnahmen in die Wege leiten, was sogar bis zum einem Verbot von ChatGPT reichen kann.

Dieter Kugelmann, Leiter der KI-Taskforce und rheinland-pfälzischer Datenschutzbeauftragter, machte gegenüber dem Tagesspiegel (öffnet in neuem Tab) klar, dass dies zwar nicht das Ziel, aber durchaus möglich sei, sollte es keine auseichende Rechtsgrundlage für die Verwendung personenbezogene Daten durch OpenAI geben. Mit Blick auf die europäische DSGVO könnte das für die Anbieter von KI-Chatbots zu einem grundsätzlichen Problem in der EU werden, da ihre Sprachmodelle große Datenmengen benötigen, um effektiv zu sein. Von daher ist es von zentraler Bedeutung, woher die verwendeten Daten kommen.

Die Bedenken gegenüber Anwendungen wie ChatGPT gehen aber über diese Frage hinaus, wie die Vorsitzende der Datenschutzkonferenz, die schleswig-holsteinische Datenschutzbeauftragte Marit Hansen, Anfang April (öffnet in neuem Tab) deutlich machte:

„Offensichtlich sind die Risiken umfassender als ‚nur‘ Datenschutz, sodass nicht nur ein Tätigwerden der Datenschutzaufsicht und beispielsweise der Landesmedienanstalten gefordert ist, sondern auch der Politik und Gesetzgebung.“

Stimmen aus der deutschen Politik

In der deutschen Politik scheint sich diese Sichtweise ebenfalls durchzusetzen: So ist Bundesarbeitsminister Hubertus Heil zwar gegen ein generelles Verbot (öffnet in neuem Tab) von Chatbots, aber für mehr Transparenz und Offenlegung der Daten, mit denen KI-Anwendungen trainiert werden. Sein Kabinettskollege Digitalminister Volker Wissing ist ebenfalls gegen Verbote und für eine „kluge Regulierung“ (öffnet in neuem Tab) von KI-Lösungen:

„Wir brauchen eine Regulierung, die ermöglicht und nicht behindert, die Raum für Innovationen lässt und nicht einschränkt. Wir wollen anwenden und nicht zurückdrängen. (…) Wir brauchen deshalb ein Gleichgewicht zwischen Innovationsfreundlichkeit, Sicherheit und klaren, verbindlichen Regeln, die einfach umzusetzen sind.“

Ähnlich sieht es SPD-Vorsitzende Saskia Esken, die zuletzt einen souveränen Umgang mit Künstlicher Intelligenz eingefordert (öffnet in neuem Tab) hat und für einen kritischen und verantwortungsvollen Umgang mit Programmen wie ChatGPT im Bildungsbereich plädiert. Verbraucherschutzministerin Steffi Lemke betonte (öffnet in neuem Tab) hingegen die Notwendigkeit von mehr Transparenz beim Einsatz von Chat-GPT, vor allem bei politischen Diskussionen im Internet: „Es muss transparent sein, wenn politische Diskussionsbeiträge von einer KI kommen.“

Wann steht die Regulierung auf EU-Ebene?

Bei einer mehrstündigen Anhörung im Bildungs- und Forschungsausschuss des Bundestages widmete sich zudem eine Expertenrunde (öffnet in neuem Tab) den Chancen und Risiken von ChatGPT & Co. Als Gefahren wurden dabei insbesondere die mögliche politische Manipulation und die Verbreitung von Falschinformationen durch Chat-Roboter sowie die fehlende Kennzeichnung bei der Kommunikation mit KI-Anwendungen genannt. Der Ausschussvorsitzende Kai Gehring (Grüne) warb deshalb am Ende für klare staatliche Regulierung:

„Unser Job wird jetzt sein, unsere natürliche Intelligenz als Gesetzgeberinnen zu nutzen, um der künstlichen Intelligenz Gestaltungsleitplanken mitzugeben.“

Diese Aufgabe wird im Sinne einer gemeinsamen europäischen Lösung derzeit zuvorderst mit dem AI-Act (öffnet in neuem Tab) der EU angegangen, bei dem auch die Entwicklungen der letzten Monate mit den KI-Chatbots oder Bildgeneratoren wie Midjourney ihren Niederschlag bei den aktuellen Verhandlungen (öffnet in neuem Tab) finden. Das Gesetzesvorhaben läuft bereits seit zwei Jahren, scheint nun aber endlich auf der Zielgeraden anzukommen. Aufgrund der weitreichenden Auswirkungen des AI-Act für alle Unternehmen, die KI-Systeme in EU-Ländern anbieten, kann es hier aber durchaus nochmal Verzögerungen geben.

Die EU ist damit immerhin schon wesentlich weiter als die USA, wo es mittlerweile ebenfalls politische (und parteiübergreifende) Bewegung in Richtung Regulierung und Kontrolle von KI gibt. Selbst der Chef von OpenAI, Sam Altman, sprach sich aktuell bei einer Anhörung vor dem US-Senat (öffnet in neuem Tab) für staatliche Regulierung von KI-Anwendungen aus. Anders als in Europa spielen Datenschutzbedenken hier zwar kaum eine Rolle, doch am Ende könnte es auch jenseits des Atlantiks irgendwann Regeln für mehr Transparenz und Sicherheitsstandards von Künstlicher Intelligenz geben.

Mehr Informationen:

Das Rennen der Textroboter: ChatGPT, Bard, Bing und die Konkurrenz aus Deutschland (öffnet in neuem Tab)

Künstliche Intelligenz: Wie steht es um den AI-Act der EU? (öffnet in neuem Tab)