Social-Media-Verbot: Warum an Plattformregulierung kein Weg vorbeigeht

Ein Social-Media-Verbot für Kinder und Jugendliche klingt nach entschlossener Politik. Tatsächlich ist es oft das Gegenteil: ein Eingriff, dort, wo es am einfachsten ist – bei den Nutzenden statt bei den Plattformen. Wer Kinder und Jugendliche wirksam schützen will, muss an die Ursachen ran – nicht an die Symptome. Konkret bedeutet das, Plattformen so zu regulieren, dass sie Minderjährige nicht länger Gefahren aussetzen.

Lange galt die Frage, ob Kinder überhaupt auf TikTok, Instagram oder Snapchat sein „dürfen“, als familiäre Verhandlungssache. Inzwischen diskutieren Parlamente, Talkshows und Leitartikel ein explizites Social-Media-Verbot für Minderjährige (öffnet in neuem Tab). Dabei verweisen sie auf Cybermobbing, Suchtgefahren, sexualisierte Inhalte, Desinformation und algorithmische Feeds, die junge Menschen in immer extremere Inhalte hineinziehen.

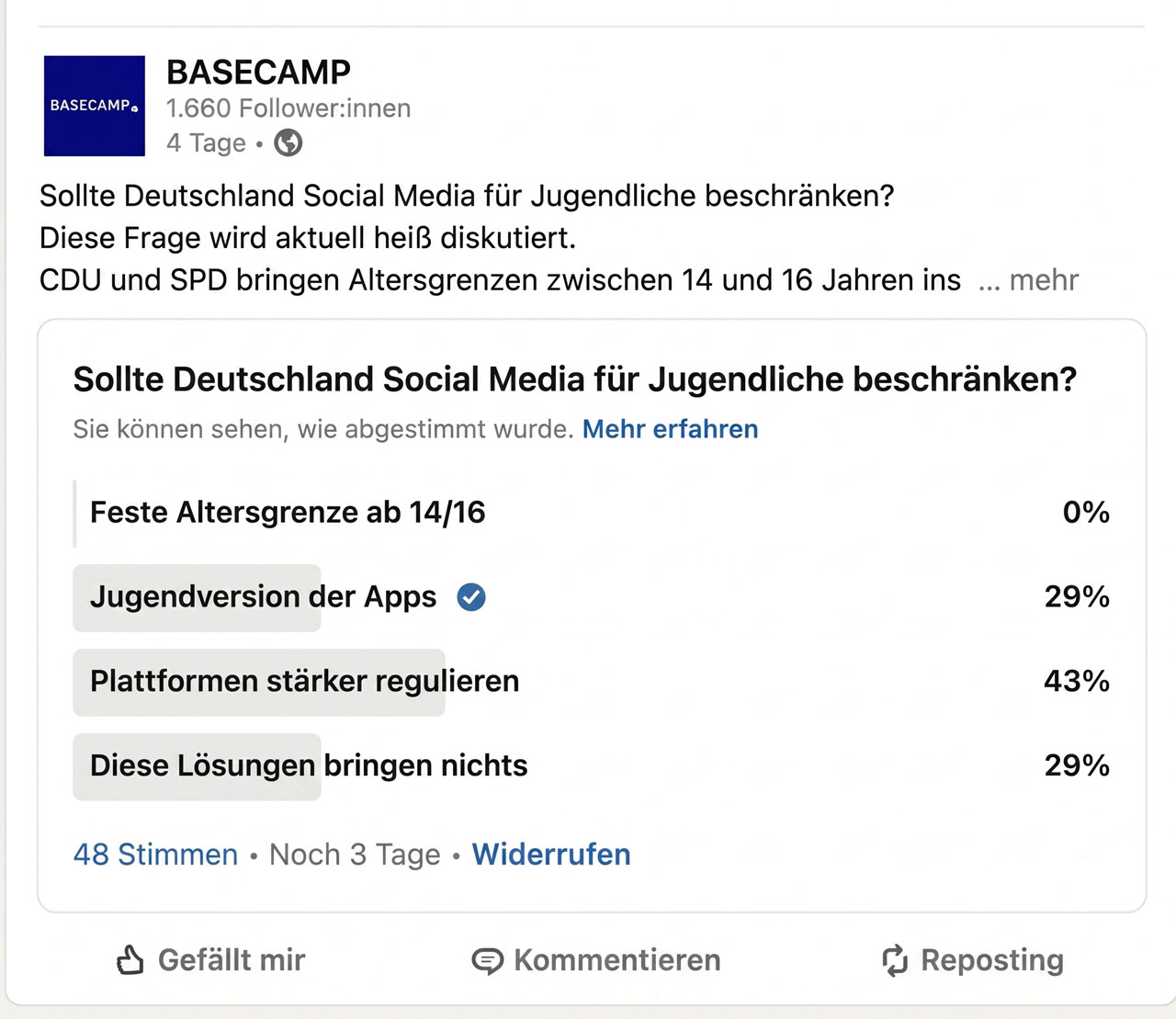

Eine Umfrage der BASECAMP Community zeichnet ein differenzierteres Bild: Während sich 43 % der Befragten für eine stärkere Regulierung der Plattformen aussprechen, sehen nur 29 % eine Jugendversion der Apps als sinnvoll an. Ein ähnlich großer Teil hält viele der diskutierten Maßnahmen insgesamt für wenig wirksam. Das deutet darauf hin, dass einfache Verbote kaum als Lösung für strukturelle Probleme wahrgenommen werden.

Zwischen Risiko und gesellschaftlicher Realität

International haben einige Staaten bereits vorgelegt: Australien (öffnet in neuem Tab) arbeitet mit strengen Altersgrenzen und Sperrpflichten für Plattformen, in Europa sprechen sich Regierungen – wie jüngst die griechische (öffnet in neuem Tab) – für ein Mindestalter von 15 oder 16 Jahren aus. Auch in Deutschland werden Forderungen laut, Kinder unter 14 Jahren ganz aus sozialen Netzwerken herauszuhalten oder nur stark eingeschränkte “Jugendversionen” zuzulassen. Die Botschaft: Wenn Social Media gefährlich ist, dann muss es von Kindern ferngehalten werden – möglichst per Gesetz.

Doch das zentrale Problem bleibt dabei unangetastet: Statt die Plattformmechanismen zu adressieren, verschieben die Gesetzesvorhaben lediglich, wer diesen Risiken ausgesetzt ist. Zugleich greifen sie an der Lebensrealität junger Menschen vorbei. Social Media ist längst ein zentraler Raum der Identitätsentwicklung, der Orientierung und des Austauschs. Gerade marginalisierte Gruppen – etwa queere Jugendliche – sind oft auf digitale Räume angewiesen, um sich zu vernetzen und Unterstützung zu finden.

Hinzu kommt: Social Media ist heute ein politisches Leitmedium: Studien (öffnet in neuem Tab) zeigen, dass sich rund drei Viertel der 16- bis 27-Jährigen dort über Politik informieren. Dass diese Informationen oft ungeprüft, verkürzt oder manipulativ sind, macht den Ausschluss nicht zur Lösung – im Gegenteil: Es zeigt, wie dringend sichere und verlässliche Zugänge zu diesen Diskursräumen gebraucht werden. Wer hier pauschal ausschließt, greift tief in Informationswege, Kultur und demokratische Sozialisation ein, ohne den Jugendlichen echte Alternativen zu schaffen.

Warum pauschale Verbote zu kurz greifen

Die Verbotsdebatte hat einen nachvollziehbaren Kern: Kinder und Jugendliche brauchen besseren Schutz im digitalen Raum.

Aber pauschale Social-Media-Verbote oder starre Altersgrenzen sind ein grobes Werkzeug für ein komplexes Problem. Sie verändern nichts an der Plattformlogik, die Aufmerksamkeit, Emotion und Polarisierung belohnt. Zudem lässt sich die digitale Lebensrealität junger Menschen nicht entlang einzelner Apps ordnen. Kommunikation, Gaming, Livestreaming, Social Media und Messenger greifen ineinander; Inhalte wandern plattformübergreifend. Wer ein Social Network verbietet, zwingt Jugendliche nicht automatisch offline – und verhindert die Nutzung nicht, sondern verlagert sie in weniger regulierte Räume – etwa In-Game-Chats oder private Gruppen, in denen Schutzmechanismen schwächer sind. Verbote verschieben Risiken – sie reduzieren sie nicht.

Der politische Reiz solcher Maßnahmen liegt auch in ihrer scheinbaren Einfachheit: Im Vergleich zur komplexen Regulierung globaler Plattformen wirken Verbote wie ein schneller Hebel. Tatsächlich verlagern sie Verantwortung jedoch von den Plattformen auf Familien und entlasten damit genau jene Akteure, die die digitalen Umgebungen gestalten.

Verantwortung klar verorten

Jugendmedienschutz ist eine gemeinsame Aufgabe – aber keine gleich verteilte. Plattformanbieter tragen die primäre Verantwortung für Inhalte und Produktgestaltung und nur sie können sichere und altersgerechte digitale Umgebungen gestalten. Der Staat setzt klare Regeln und sorgt für deren Durchsetzung.

Schulen und außerschulische Bildungsangebote spielen eine zentrale Rolle, indem sie Medienkompetenz systematisch vermitteln und Räume für Reflexion und Orientierung schaffen. Programme zur Förderung digitaler Kompetenzen können hier wichtige Impulse setzen und junge Menschen wie auch Eltern konkret im Alltag unterstützen. Und auch den Eltern kommt eine zentrale Rolle zu: als Begleitende, als Orientierung gebende Instanz und nicht zuletzt als Vorbilder im eigenen Medienumgang.

Doch klar ist: Selbst ein perfektes Zusammenspiel aus Schule, Bildungsangeboten und Elternhaus stößt an Grenzen, wenn Plattformen strukturell auf maximale Aufmerksamkeit und Verweildauer ausgerichtet sind. Verantwortung der Einzelnen ist wichtig – sie kann systemische Risiken aber nicht allein ausgleichen.

Regulierung, wo Risiken entstehen

Ein wirksamer Jugendmedienschutz muss dort ansetzen, wo Risiken tatsächlich erzeugt und verstärkt (öffnet in neuem Tab) werden – und gleichzeitig die Rolle aller Beteiligten mitdenken: im Design der Plattformen, in algorithmischen Empfehlungssystemen, Interaktionsmechaniken und Geschäftsmodellen. Genau hier setzt der europäische Regulierungsrahmen an (zumindest in seiner Ambition).

Der Digital Services Act (DSA) verpflichtet sehr große Online-Plattformen dazu, systemische Risiken für Minderjährige zu analysieren, zu reduzieren und transparenter über die Funktionsweise und Effekte ihrer Algorithmen zu berichten. Der geplante Digital Fairness Act (öffnet in neuem Tab) adressiert manipulative Designpraktiken wie Dark Patterns und suchtfördernde Mechaniken. Das Prinzip: nicht nur Inhalte moderieren, sondern auch die Systeme, die dahinterstehen.

Schutz, Befähigung, Teilhabe – statt Ausstieg aus Social Media

Moderner Jugendmedienschutz braucht keinen “Notausgang” aus Social Media, sondern einen konsequenten Dreiklang aus Schutz, Befähigung und digitaler Teilhabe.

Schutz heißt: Plattformen müssen regulatorisch stärker gebunden werden. Sicherheit muss durch Safety-by-Design-Prinzipien gewährleistet sein – etwa durch restriktive Voreinstellungen, effiziente Meldesysteme und eine Reduktion aggressiver Benachrichtigungs-Anreize. Dabei ist ein plattformübergreifender Ansatz essenziell, der die Risiken in Social Media, Gaming, Messengern und Livestreaming gleichermaßen adressiert.

Befähigung heißt, Medienkompetenz ist als integraler Bestandteil in Schule, Jugendarbeit und Familie zu verankern. – mit einer ernst gemeinte Medienbildungsoffensive.

Diese muss Menschen dazu befähigen, die Funktionsweisen von Algorithmen, die Mechanismen von Desinformation sowie den sozialen Druck in algorithmischen Feeds zu durchschauen. Gleichzeitig gilt: Individuelle Kompetenz darf nicht als Alibi für strukturelle Design-Fehler dienen, die auf maximale Verweildauer optimiert sind.

Teilhabe schließlich bedeutet, digitale Räume nicht zu schließen, sondern sie sicher zugänglich zu halten. Social Media Plattformen sind heute ein zentraler Raum demokratischer Öffentlichkeit. Sie ermöglicht politische Partizipation, Diskurs und Organisation. Ein pauschaler Ausschluss ohne adäquate Alternativen würde eine gesamte Generation von ihren wichtigsten Interaktionsräumen isolieren.

Sinnvolle Regulierung zielt nicht auf die Verdrängung aus dem digitalen Raum ab, sondern auf dessen Absicherung.

Ein technischer Baustein hierfür können europäische, datensparsame Altersverifikationslösungen sein, etwa im Rahmen einer EU-Digital-Identity-Wallet, die einheitliche Altersnachweise erlaubt, ohne unnötig viele persönliche Daten offenzulegen. Entscheidend bleibt aber: Die Verantwortung für die Altersdurchsetzung liegt bei den Diensten – nicht bei der Netzinfrastruktur.

Ultima Ratio statt einfache Antwort

Am Ende bleibt die Frage: Was tun, wenn Plattformen Regeln ignorieren und systemische Risiken für Minderjährige in Kauf nehmen? In solchen Fällen braucht es wirksame Aufsicht mit echten Sanktionen – inklusive hoher Bußgelder, klarer Auflagen und struktureller Anpassungspflichten im Sinne von „Safety-by-Design“. Netzsperren können allenfalls als Ultima Ratio eine Rolle spielen: eng begrenzt, rechtsstaatlich abgesichert, technisch überprüfbar und niemals als Standardinstrument.

Die eigentliche Nagelprobe der kommenden Jahre wird sein, ob Europa den Mut hat, die Macht großer Plattformen wirklsam zu begrenzen – und dabei Schutz, Befähigung und digitale Teilhabe zusammen zu denken. Oder ob der Ruf nach Social-Media-Verboten am Ende vor allem eines signalisiert: dass man lieber Kinder ausschließt, als die Architektur der digitalen Öffentlichkeit grundlegend zu verändern.

Event-Hinweis:

Am 24. April werden Dr. Zoe Mayer, Rasha Nasr, Pascal Reddig, Lilli Berthold und Jan Schipmann (Moderation) zu Gast im BASECAMP sein, um zum Thema „Brauchen wir eine Stopp-Taste für TikTok & Co? – Gesunde Nutzung, politische Werbung, Desinformation und die Verbotsdebatte im Fokus“ zu diskutieren.

Die Anmeldung für den Livestream für Interessierte erfolgt per Mail an wakeup@yaez.com (öffnet in neuem Tab) (öffnet in neuem Tab).

Mehr Informationen:

Social-Media-Verbot: Was der Rest der Welt probiert und wo Deutschland steht

Das crazy: Warum Social Media über die Zukunft der Demokratie entscheidet

Symbolpolitik oder Zukunftsfrage: Smartphone-Verbot in Schulen